はじめに

この数年で、人工知能は目覚ましい発展を遂げています。大規模言語モデルは人間レベルの言語生成能力を備え、マルチモーダルモデルはテキストと画像を横断して推論しています。また、特定の分野では専門家に匹敵する性能を発揮しています。

このように高度化されたAIが私たちの日常生活や社会に深く浸透するにつれ、「単に精度が高く、高速なAIだけで十分なのか」という疑問が生じています。人間が理解できない意思決定、社会的文脈を無視した設計、そして責任が不明確な自動化は、かえってリスク要因として作用する可能性があるからです。こうした背景から、人間中心のAI、つまり人間の能力を強化し、人間と協力し、人間の責任と倫理を尊重するよう、AIの方向性を定めるべきだという声が高まっています。

今年3月、イタリアのカリアリで開催されたカンファレンスIUI(Intelligent User Interfaces) 2025は、このような問題意識を共有し、議論する場でした。IUIは人工知能と人間コンピュータ相互作用(human-computer interaction、以下HCI)の接点に立つカンファレンスとして、単純な性能競争を超え、人間を中心に据えたインターフェースとシステム設計を志向しています。今年は複数の登壇者がそれぞれの視点から「AIの持続可能性」というテーマを取り上げ、これにより、学界と産業界全体が今後目指すべき方向性を読み取ることができました。

私も論文を発表するために今回のカンファレンスに参加しましたが、さまざまなセッションを通じて、多くの研究者の問題意識や解決策に触れることができました。その中でも特に記憶に残ったのは、Albrecht Schmidt氏とQ. Vera Liao氏、Jerry Alan Fails氏のセッションでした。彼らはAI活用に関連して重要な論点を提起しました。この記事では、各発表を聞いて得たインサイトに基づき、発表の核心を要約し、私の考えをまとめてみたいと思います。

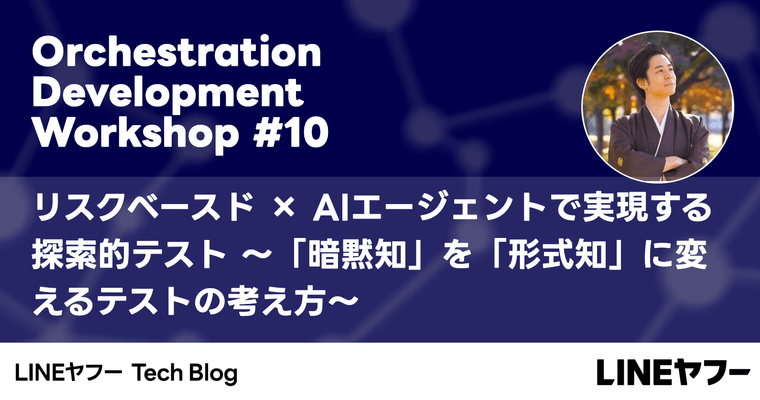

Reality Design: Shaping Experiences Beyond Interfaces through Human-Centered AI, Albrecht Schmidt

最初に紹介する発表は、Albrecht Schmidt教授のキーノートです。長年にわたって人間中心のインタラクションと拡張技術を研究してきた学者として、今回の発表では「リアリティデザイン(Reality Design)」という概念を中心に、人間とAIの関係を再考しました。

Schmidt氏の主張は明快でした。これまでのHCI研究が主に画面やデバイスという狭い枠組みの中でインターフェースを扱ってきたのに対し、これからは現実そのものを設計対象とすべきだということです。AIとセンサー、ウェアラブルデバイス、拡張現実(XR)などの技術が日常生活に統合されるに��つれ、人間の知覚や認知、記憶そのものが技術と結びつき、人間の能力が拡張(augmented)され得ると述べました。彼はこれを「リアリティデザイン」と名付け、人間の経験全体をデザイン対象とする必要性を強調しました。

発表では、人間の能力が拡張された具体的な事例も紹介されました。例えば、記憶拡張研究では、個人が経験した出来事や会話をAIが自動的に記録しておき、必要なときに呼び出して再構成できるシステムを実験した事例が紹介されました。カウンセリングや教育、研究といった分野において、人間が見落としがちな部分を補い、関連する事柄のより深い理解を可能にしているとのことです。感覚拡張の事例では、現実の特定の動作をスローモーションで再現して観察力を高めたり、特定の音声を選択的に聴取できるようにしてユーザーの知覚能力を強化する技術が紹介されました。また、AIが人間の認知能力レベルに合わせて作業の難易度を調整する方式を示すためのレゴブロック実験も実演されました。この実験は、協調的知能がどのように設計できるかをよく示していました。

Schmidt氏は、単に技術で何ができるかを列挙するだけでなく、技術が人間の思考と学習意欲を落とさないよう注意すべき点も指摘しました。例えば、自動化された記憶拡張装置が過度に発達すると、人間は自ら記憶したり学習したりしようとする動機を失う可能性があります。また、古代哲学者ソクラテスが書くことの発明を批判した「書くことは忘却をもたらす」という警句を引用し、新しい技術が人間の認知能力を代替する際に生じうる危険性を警告しました。

発表の最後には、「We shape our reality; thereafter it shapes us」という文が紹介されました。この文は、技術と人間の関係が一方通行ではなく、循環的である点を再認識させました。

私を含む聴衆は実験事例に興味を抱き、発表で提起された哲学的な問いに共感したと思います。単に「新しい技術をどう作るか」ではなく、「その技術が人間をどのような存在にするのか」という根本的な問いを投げかける、非常に意味のあるセッションでした。

Human-Centered AI Transparency: Bridging the Sociotechnical Gap, Q. Vera Liao

次に印象的だったセッションは、Vera Liao教授の「Human-Centered AI Transparency」です。そのテーマは、最近発表された論文「AI Transparency in the Age of LLMs: A Human-Centered Research Roadmap」とも関連しています。AI Transparency(AIの透明性)は現在、社会的に最も重要な話題の一つです。例えば、人々は金融、医療、ローン審査、自動運転といった高リスク領域において、AIの判断をそのまま受け入れることはありません。その判断がどのように下されたのか、他の条件であれば結果が変わったのか、エラーが発生した場合にどのように修正できるのかについて、必ず答えを求めます。

Liao氏は、従来の技術的な説明可能性(AIシステムの意思決定プロセスを人間が理解し、信頼できるように説明する技術および方法論)研究の限界を指摘しました。単にモデルの内部動作原理を列挙したり、数学的指標を提示したりする従来の手法は、実際のユーザーにはほとんど役に立たないと述べました。その代わりに、「社会技術(socio-technical)的なギャップを埋めること」が必要だと強調しました。AIの透明性は技術的な観点に留まらず、ユーザーが実際に理解して信頼できるレベルで実現されるべきだということです。

発表では、AIの透明性を達成するための具体的なアプローチが紹介されました。

- 不確実性コミュニケーション:結果が確定的でない場合、それを隠さず明確に伝える。

- 反事実的説明:もし条件が異なっていたら結果はどのように変わったかを論理的に追跡するシナリオを提供し、ユーザーの理解を助ける。

- 相互作用に基づく透明性:ユーザーがフィードバックを提供し、モデルがそれを反映する構造を通じて、ユーザーが単なる消費者ではなく「調整者」として位置づけられるようにする。

さらに、Liao氏の論文ではLLM時代の透明性が直面する新たな難題が指摘されています。LLMは能力が予測不可能であり、同じ質問に対して異なる回答を出す不安定性も見られます。学習データは膨大で不透明なもので、「プロンプトエンジニア」のような新たなステークホルダーまで登場しました。したがって、透明性は単一の定義に変換できず、「ステークホルダーと文脈、目標によって変わるべきである」という点を強調しました。

特に、これまでのHCIとAIの研究�で得られた教訓に基づき、透明性は「手段」であるとした上で、「透明性の目的はモデル改善、学習、規制遵守、信頼形成など多岐にわたり、すべての状況に同一水準の透明性が求められるわけではない」と述べました。つまり、透明性は無闇に信頼を高めようとする手段ではなく「適切なレベルの信頼」を形成するための手段であるべきだと強調しました。透明性だけを確保して統制手段を確保できなければ、ユーザーには挫折感だけが残るため、「透明性と統制は必ず共に設計しなければならない」という点も重要なメッセージでした。

以下は、研究者と産業界がこれまで蓄積した4つの主要なアプローチを整理したものです。

- モデル報告(model reporting):モデルカード(例:Gemma 3 モデルカード)のような文書化およびデータと開発背景の透明化

- 評価結果の共有(evaluation results):単純な性能数値だけでなく、バイアス、安全性、リスク評価を含む

- 説明の提供(explanations):反事実的説明、事例に基づく説明など多様な方法での説明

- 不確実性コミュニケーション(uncertainty communication):数値だけを伝えるのではなく、数字以外に言語的・視覚的により多様で豊かな表現手段を活用

相互補完的に機能するこれら4つのアプローチは、いずれも人間中心設計が核心です。発表では、「AIが信頼されるために必要なのは、単に高い性能ではなく、ユーザーが納得できる説明可能性である」と繰り返し強調されました。実際、発表直後に研究者たちは「自分のシステムにどう反映できるか」あるいは「説明可能なことが本当に意味を持つのか」について活発に討論しました。関連規制が新設されるなど、法整備が急速に進む現状において、Liao氏の提案は実際に役立つものでした。

結局、彼女のメッセージは、透明性とは単にモデル内部を公開するだけに留まってはならず、人々の目標や認知的限界、社会的文脈を考慮して設計することまで進むべきだという意味でした。また、時には透明性だけでは不十分であり、責任とそれを支える制度的な仕組みが共に整った時に初めて人間中心のAIが可能になるということです。私自身も業務でさまざまなAIエキスパートシステムを制作する中で、漠然と感じていた部分でした。それを明確に認識できるようになり、非常に印象深いセッションでした。

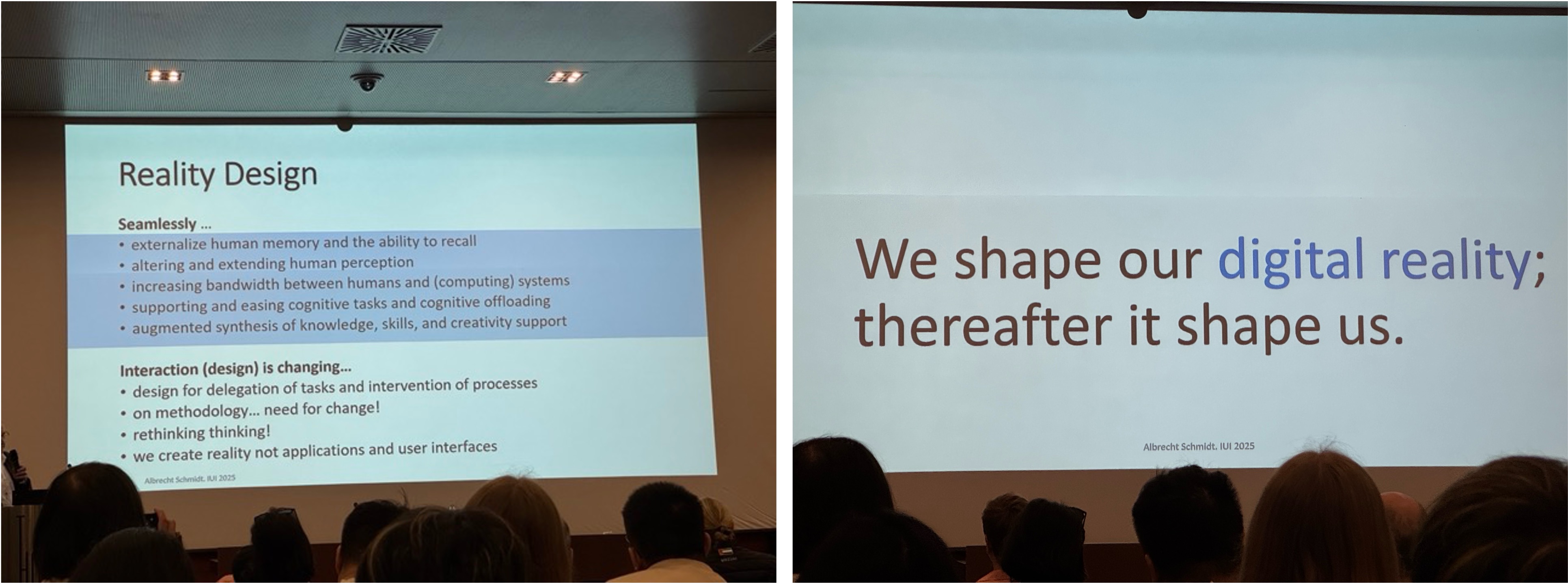

Interactive Machine Learning, Jerry Alan Fails

3つ目は、Jerry Alan Fails教授のセッションです。

発表資料:https://giove.isti.cnr.it/iui25-keynotes/Jerry_Fails_keynote.pdf

Fails氏は、2003年に発表したInteractive Machine Learning(以下IML)論文により、IUI 2025で「Impactful Paper Award」を受賞しました。発表から長い時間が経過しているにもかかわらず、依然として影響力があると認められた理由は、そ��の論文のアイデアが現在の研究の流れと密接に関連しているためです。

その論文は当時、伝統的な機械学習の限界を指摘し、ユーザーが学習プロセスに直接介入する手法を提案しました。従来のモデルは、決められたデータで学習した後、結果だけを出力していました。しかし、Fails氏は、ユーザーがモデルの分類結果を確認して、誤った部分を修正し、その修正が再びモデルの学習に反映されるインタラクティブなループを設計しました。これにより、機械学習が単なる自動化ツールではなく、ユーザーと共に成長するツールとなり得ることを示しました。今日では「Human-in-the-Loop」という概念として広く知られていますが、当時は非常に革新的なアプローチでした。

今回の発表で彼は、IMLが単なる過去のアイデアではなく、現在も活発に引用・応用されていることを強調しました。教育ツールでは、学生が自らデータを操作しながらモデルを学習させる方法として活用されており、ユーザー中心のインターフェースデザインでは、AIがユーザーの行動に合わせて適応する構造につながっています。また、研究支援ツールでは、大規模データ分析にユーザーのフィードバックを反映する方法論としてIMLの概念が活用されています。

発表を聞いて、2003年に発表された論文が時代を超えて現在の研究や開発現場につながっている点が非常に印象的でした。「良いAIとは、単独で優れた性能を発揮するものではなく、ユーザーと相互作用しながら成長するAIである」というメッセージは、今日、人間中心のAIが重視される潮流に合致していると考えました。

Counselor-AI Collaborative Transcription and Editing System for Child Counseling Analysis, 이형중

私は今回のIUI 2025で、Counselor-AI Collaborative Transcription and Editing System for Child Counseling Analysisという論文を発表しました。この研究は、韓国の成均館大学校のDSAILと、明知大学校のYoujin Han教授の研究室との共同研究として進められ、LINE Plusの支援を受けて発表されました。

研究の内容は、児童カウンセリング現場でカウンセラーが直面する逐語録(カウンセリングや対話で発生したすべての言語的・非言語的表現を文字で記録した文書)作成の困難さを解決するためのシステムです。児童カウンセリングでは、成人カウンセリングと異なり、言語的な発話だけでなく、表情、身振り、行動といった非言語的な手がかりが非常に重要です。そのため、カウンセラーはきめ細かな非言語的な手がかりとその文脈まで記録する必要があり、非常に多くの時間が費やされます。1時間のカウンセリングを文字起こしするのに、3時間から8時間以上かかることもあります。

私が提案したシステムは、AIベースの自動逐語録モ��デルとカウンセラー用の編集ダッシュボードで構成されます。自動逐語録モデルは、子どもとカウンセラーの発話を区別し、非言語的表現を映像から抽出して記録します。カウンセラーはこの自動逐語録を基に、ダッシュボードで結果を確認して修正できます。AIは客観的かつ迅速な記録を提供し、カウンセラーは文脈や意味を反映して補完することで、協働分析が可能となります。48名の児童カウンセリング専門家を対象とした実験では、93.75%がこのシステムを継続利用したいと回答しました。実際のカウンセリング現場で業務負担を軽減し、カウンセリング分析の品質を向上できることを確認しました。

今回の研究で特に注目すべき点は、AIが提供する客観的な記録とカウンセラーの文脈的な解釈が相互補完的に機能することが、カウンセリング分析の精度向上だけでなく、カウンセラーの専門性発達や自己内省にも役立つことを確認できた点です。この研究は、Schmidt氏が述べた人間能力の拡張、Liao氏が強調した透明性、Fails氏が示した相互作用的な学習といった、今後AIが進むべき方向性に近いものです。結局、このシステムもAIが独立してすべてを決定するのではなく、人間の専門家と協力しながら文脈を反映する構造を目指しているからです。

おわりに

Albrecht Schmidt氏のリアリティデザイン、Vera Liao氏の透明性、Jerry Alan Fails氏のインタラクティブ機械学習、そして私の研究まで。それぞれの発表と論文は、すべて異なるテーマを扱っていますが、最終的には同じ問いへと収束すると思います。

「AIは人間を代替するのか、それとも人間を強化するのか?」

IUI 2025で私はこの問いに対してある程度答えを得たと考えています。AIは人間と共に設計され、透明性をもって説明され、人間の能力と責任を尊重する方向に発展すべきだということです。このような方向性において、私の研究も意味を持つことができたので、嬉しい時間でした。

最後に、IUI 2025が開催されたカリアリの街の写真を紹介します。長文をお読みいただき、ありがとうございました。