こんにちは。LINEヤフー研究所でHuman-Computer Interaction(HCI)の分野の研究をしている池松です。

皆さんはスマートフォン(以下、スマホ)でレシピを見ながら調理しているときに、指が汚れていて画面に触れられなかった経験はありませんか?あるいは、手袋をつけた状態で操作しようとして、うまくタッチできずにもどかしい思いをしたことはないでしょうか?

この記事では、そんな課題に対処するタッチレス操作技術「ReflecTrace」について解説します。本技術は、瞳に映る画面の反射像を分析して、空中での指の位置を推定する技術です。衛生面や利便性の向上はもちろん、ホバー操作による新しいUIデザインの可能性を広げる本研究の仕組みと展望をご紹介します。本研究はLINEヤフー研究所と慶應義塾大学、東京工科大学との共同研究です。本研究成果は国際会議ACM IUI 2026 に採択されており、会議は当初2026年3月開催予定でしたが、2026年7月に延期されました。論文は当初の開催予定に合わせて公開されています[1]。

タッチ操作を補完するホバー操作の必要性

スマホのタッチ操作は直感的で使いやすい入力手法として広く普及しています。しかし、特定の状況ではタッチ操作だけでは対応が困難な場面があり、これを補完する入力手法としてホバー操作への期待が高まっています。

例えば、手指が汚れている場合や手袋を着用している場合、画面のタッチ操作は難しくなります。また、新型コロナウイルスの流行以降、共用デバイスに直接触れたくないという衛生面でのニーズも高まっています。

このような背景から、画面に触れることなく操作できる「ホバー操作」技術への注目が集まっています。一方で、画面付近のフロントカメラでは直接捉えることのできない空間でのホバー操作は、これまで特殊なセンサが必要でした。例えば、Google Pixel 4に搭載されたSoliレーダーセンサ*などがありますが、このような専用センサを搭載する機種は限られていました。

瞳の反射を使ったアプローチ「ReflecTrace」

私たちが開発したReflecTraceは、従来とは異なるアプローチでこの問題にアプローチします。キーとなるのは、人の瞳(角膜)に映るスマホ画面の反射です。

基本的な仕組み

ReflecTraceは、私たちが以前開発したスマホの持ち方推定技術「ReflecTouch」[2]の知見を応用した研究です。ReflecTouchでは角膜反射像を使ってスマホの持ち方を推定していましたが、ReflecTraceでは同じ角膜反射像の技術を使って画面上の指のホバー位置を推定します。

人がスマホを見つめているとき、瞳の表面にスクリーンが映り込んでいます。ここで指をスクリーンの近くにかざすと、その指が瞳に映るスクリーンの反射を部分的に遮り、「指の影」が現れます。この影の位置や形は、指がスクリーンのどの位置にあるかによって変わります。

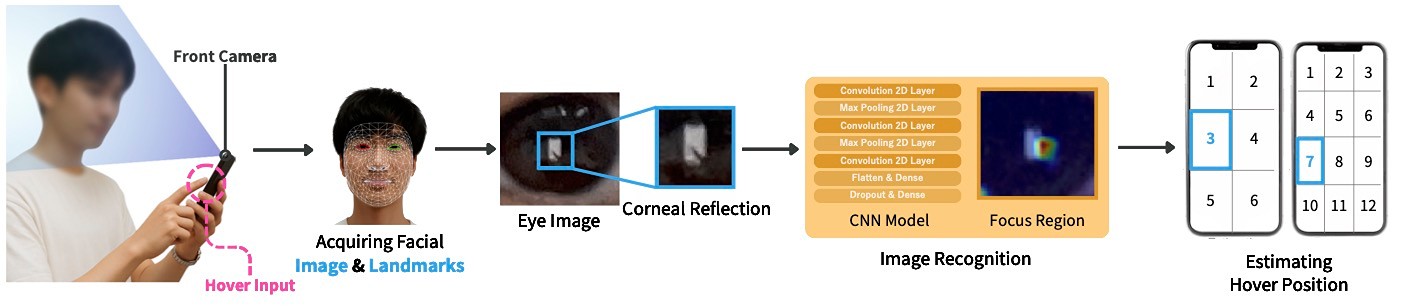

ReflecTraceのシステムは以下のステップで動作します(図1):

- 顔画像の撮影: スマホの内蔵フロントカメラで顔を撮影

- 目領域の検出: GoogleのMediaPipeを使用して自動的に目の輪郭を検出

- 角膜反射像の抽出: 瞳に映るスクリーンの反射部分を切り出し

- 位置推定: 畳み込みニューラルネットワーク(CNN)で指の2次元位置を推定

フロントカメラで撮影した顔画像から目領域を検出し、角膜反射像を抽出。指による影の情報を機械学習で解析して、2次元のホバー位置を推定する。

技術的な特徴

この手法の最大の利点は、追加のハードウェアが不要で、既存のスマホの標準機能のみ使用することです。カメラが直接見ることのできない「画面近くの空間」での指の位置を、瞳の反射という間接的な情報から読み取ることで、従来困難だった領域でのセンシングを実現しています。

実装とユーザ実験による検証

ReflecTraceのシステム実装とその性能検証のため、16名の参加者(男性9名、女性7名、平均年齢23.6歳)による実験を実施しました。この実験では、CNNの学習に必要なデータ収集と、構築したモデルの精度評価を並行して行いました。

実験条件

ユーザの姿勢変化は目とスクリーンの距離や視角を変え、これはカメラで取得する角膜反射像に影響するため、実際のスマホ使用場面を想定した4つの異なる姿勢(立位、座位、うつぶせ、あおむけ)と3つの画面明度レベル(100%、85%、70%)の組み合わせでデータを収集しました。本実験にはiPhone 11(フロントカメラ解像度 12Mpx)を使用しました。

精度検証結果

収集したデータセットを用いてCNNモデルを学習し、複数の観点から性能を検証しました。

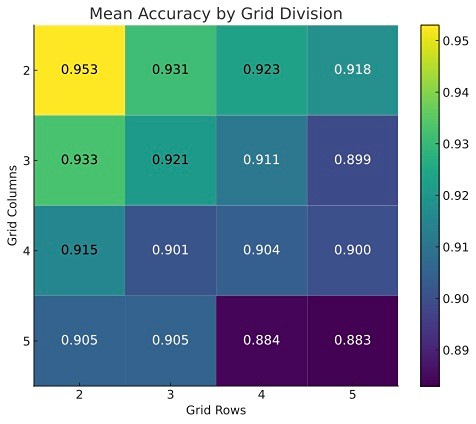

画面分割の精度では、収集したデータを用いて、画面を異なる分割数で評価した際の指位置推定精度を測定しました(図2):

- 4分割(2×2): 95%程度の精度を達成

- 25分割(5×5): 88%程度の精度を維持

2×2から5×5の各分割設定における精度を色で表示。暖色ほど高精度を示す。

最も荒い分割数(4分割)では、個別のエリアごとに見ても精度が90-96%の範囲に収まり、隣接エリア間での誤認識が主な要因であることも確認できました。

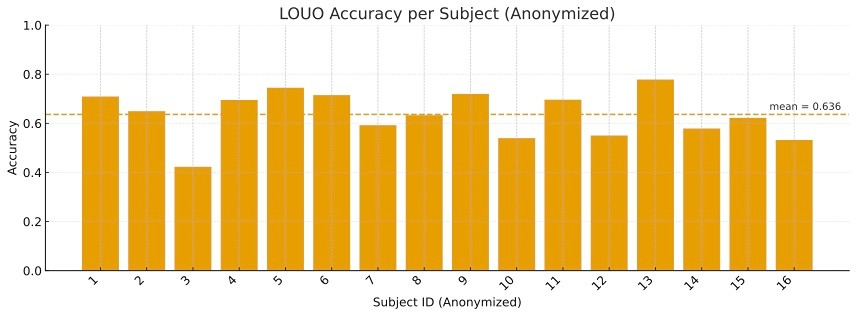

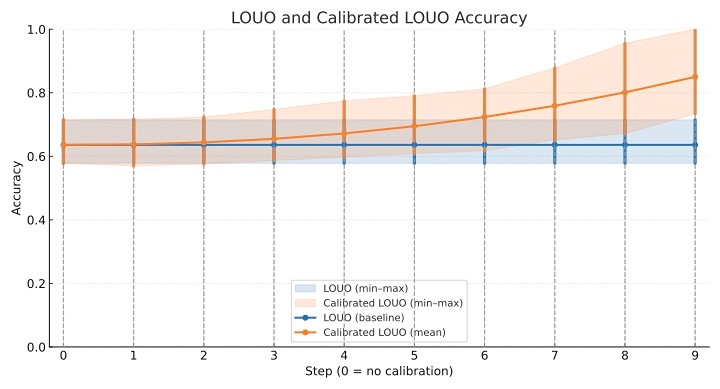

個人差の評価では、Leave-One-User-Out交差検証により、未知ユーザに対する汎化性能を検証しました(図3)。この評価では平均63%程度の精度となり、参加者間では42%から78%の範囲でばらつきがありました。この結果は個人差による課題を示していますが、次に述べる少量の個人データによるキャリブレーション(調整)により改善が可能であることも確認しました。

各参加者をテスト対象とした際の精度。

個人適応による性能向上

個人差による精度の低下に対処するため、少量の個人データを使ったキャリブレーション手法も検証しました。これは、各ユーザが初回使用時に短時間のデータ収集を行うことで、そのユーザに最適化されたモデルを作成する仕組みです。

その結果、わずかなキャリブレーションデータでも精度が向上することが分かりました(図4):

- 少量のデータ(Step 4以降)で平均70%以上の精度

- より多くのデータ(Step 8以降)で平均80%以上の精度

実線は被験者全体の平均精度を示し、ベースのLOUOモデル(青)とキャリブレーション後(オレンジ)を比較。影付き範囲は各ステップでの最小-最大値を表す。Step 0はキャリブレーションデータなし、Step 1-9は段階的にキャリブレーションサンプルを追加(各ステップ864枚)。

リアルタイム処理性能

入力インターフェースに�おいて重要なレスポンス速度についても測定を行いました:

- 平均処理時間(end-to-endレイテンシ): 22.1ミリ秒

- 処理速度: 約45Hz(1秒間に45回の処理が可能)

この速度は、人間が「瞬時」と感じる100-200ミリ秒の範囲[3]を下回っており、リアルタイム操作に対応できる性能です。

操作体験の可能性

ReflecTraceによって実現されるインタラクションの例をご紹介します。

タッチ操作の拡張

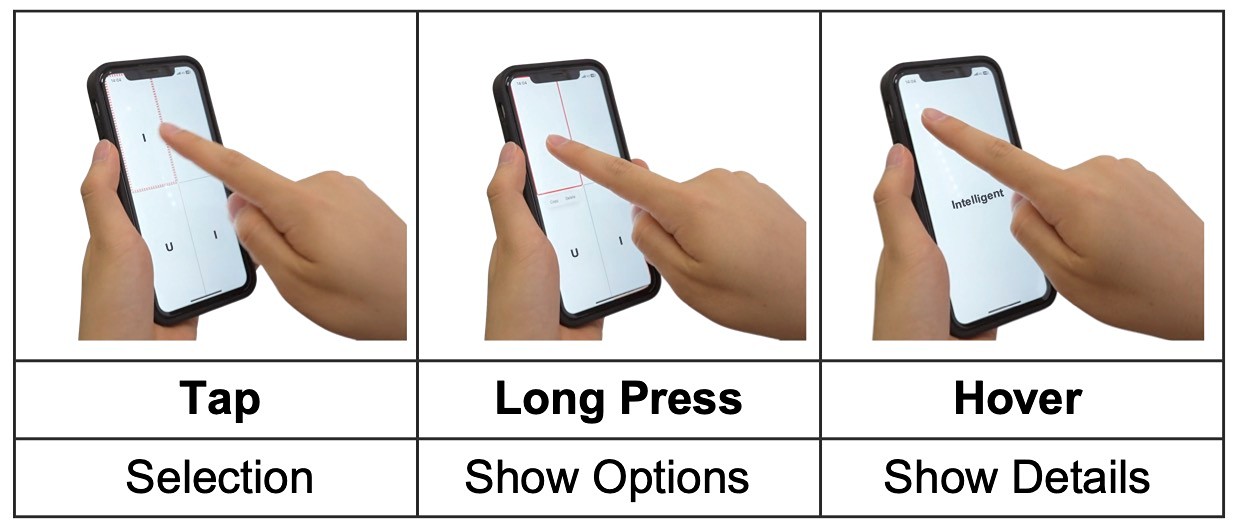

最もベーシックな応用例として、従来のタップ、ロングプレスに加えて、ホバー操作を追加できます:

- タップ: 選択・決定

- ロングプレス: コンテキストメニュー表示

- ホバー: 詳細プレビュー表示

このような3種類の操作により、アクションを実行する前に内容を確認できるため、操作ミスを減らしながら、画面上にボタンを増やすことなくリッチな操作が可能になります(図5)。

タップ=選択、ロングプレス=コンテキストメニュー、ホバー=詳細プレビューの操作を実現。

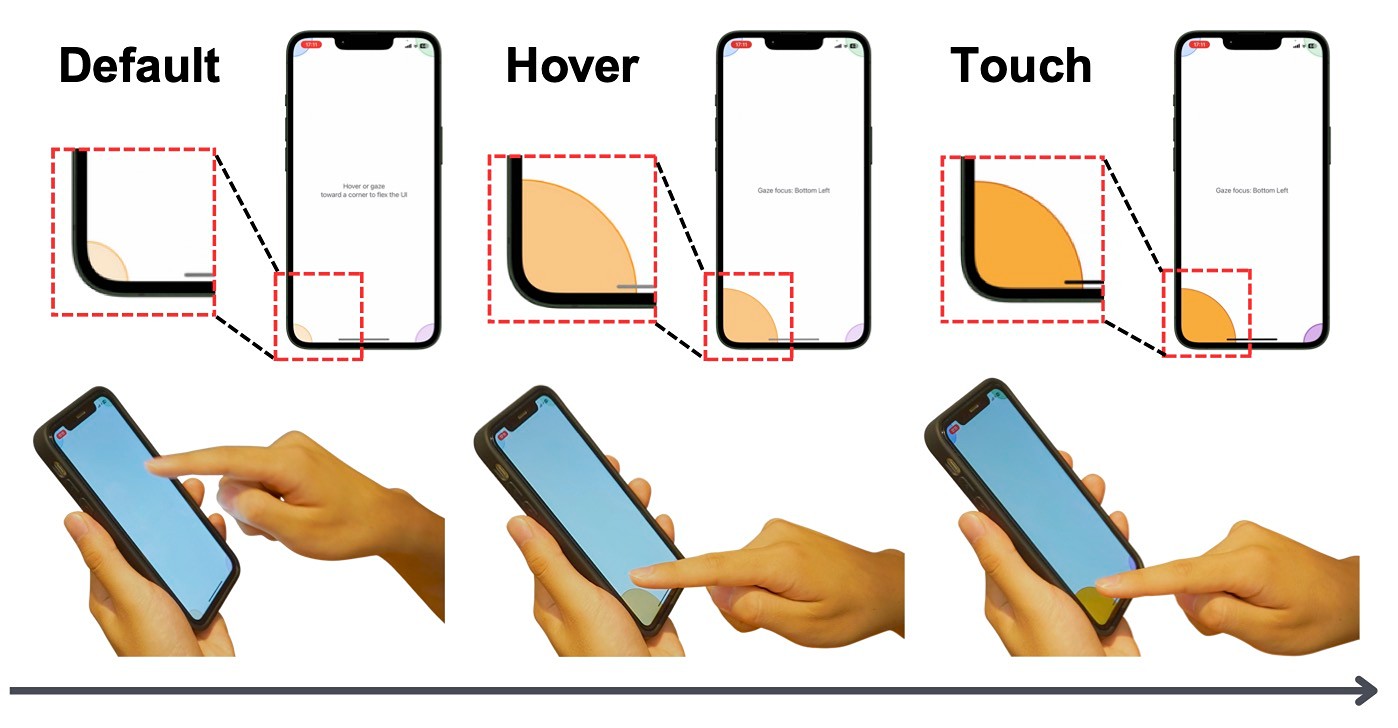

先読み対応インターフェース

指が画面に近づいていることを事前に検知できるため、タッチする前にUIを動的に調整することも可能です。例えば、小さなボタンに指が近づくと、自動的にそのボタンを拡大表示し、操作時の精度向上をサポートできます(図6)。

指の接近を事前に検知し、タッチ前にUIが動的に調整される。

おわりに

いかがでしたでしょうか。角膜反射像を活用したReflecTraceは、特殊なセンサに頼らずとも、私たちの日常の操作体験をより豊かに、より自由にする可能性を秘めています。本記事が、インタラクション設計や技術開発における一つのヒントになれば幸いです。

* Motion Sense - Google Pixel 4 と新しいコミュニケーション方法. https://support.google.com/pixelphone/thread/27693356/

参考文献

[1] Yudai Nakamura, Kaori Ikematsu, Naoto Takayanagi, Kunihiro Kato, Toshiya Isomoto, Yuta Sugiura. "ReflecTrace: Touchless Hover Interaction on Commodity Smartphones via Corneal Reflection" In Proceedings of the 2026 International Conference on Intelligent User Interfaces (IUI '26).

https://dl.acm.org/doi/10.1145/3742413.3789138

[2] Xiang Zhang, Kaori Ikematsu, Kunihiro Kato, and Yuta Sugiura. "ReflecTouch: Detecting Grasp Posture of Smartphone Using Corneal Reflection Images." In Proceedings of the 2022 CHI Conference on Human Factors in Computing Systems (CHI '22).

https://dl.acm.org/doi/10.1145/3491102.3517440

[3] Steven C. Seow. "Designing and Engineering Time: The Psychology of Time Perception in Software." Addison-Wesley Professional, 2008.